半监督学习

什么是半监督学习

半监督学习是 1.利用未标记样本的信息 提升学习器泛化性能 2. 不依赖外界信息交互的学习方法 (主动学习 依赖外界信息交互)

半监督学习如何利用未标记样本的信息: 分布假设

将未标记样本的所隐含的数据信息同类别标记相联系,也就是分布假设,通常有聚类假设,流行假设

- 聚类假设:假设数据存在簇结构,属于同一个簇的数据点 从属于同一个类别

流行假设:假设数据分布在流形结构上,相近的数据点拥有相似的输出值 可以看出流行假设比聚类假设应用范围更广,适用于更多的数据

这两种假设的本质都是: 相类似的数据拥有相类似的输出半监督学习类型的划分

- 纯半监督学习:假设训练数据中的未标记样本,并非待预测数据

- 直推学习: 假设训练数据中的未标记样本即为带预测数据

可见前者基于开放世界假设,后者基于封闭世界假设,对于前者来说,当新的数据来临,不必训练新的学习器,可以用于在线任务,而后者则不可以,当有新的数据需要预测时,需要训练新的学习器。

几种半监督学习的方法

本节摘录机器学习一书中的几种半监督学习方法,在未来的学习中,若遇到新的学习方法,会有增加

基于生成式模型的半监督学习方法

生成式方法: 所有数据都由同一个模型生成,其模型某些参数未知,学习的过程就是通过数据对模型参数估计的过程,得到模型参数后,模型已知,那么对于unlabelled数据的判别就很简单了。

生成式方法的半监督学习的分布假设既不是聚类假设,也不是流形假设,而是假设数据的生成式模型。

高斯混合模型为生成式模型的半监督学习

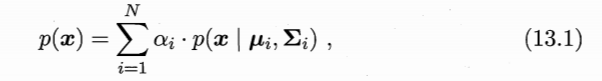

假设数据服从高斯混合模型:

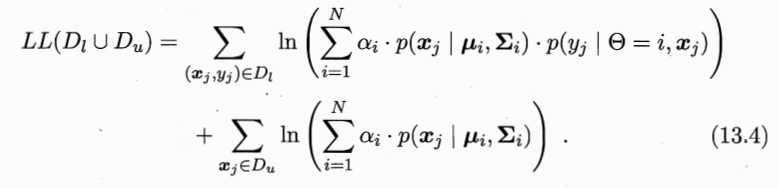

给定有标签数据和无标签数据,该模型的极大似然函数是:

前半部分是对于利用有标签数据进行估计,后半部分则是利用无标签数据进行估计,那么通过大量无标签数据的估计,可以提升参数估计的效果。 参数估计的过程可以右EM算法得出。

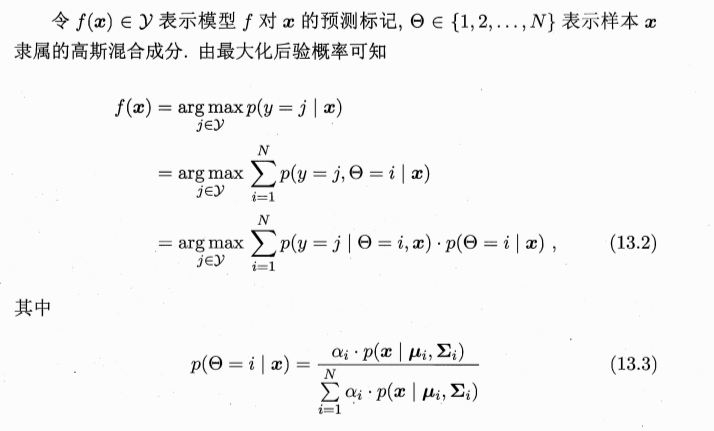

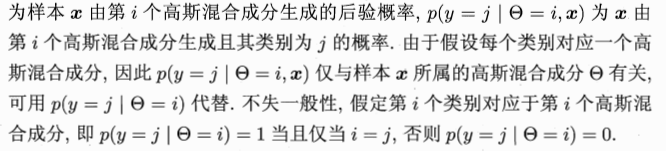

得到参数后,生成式模型对我们就是已知的了,那么我们想要的判别函数就是:

至此我们就可以得到判别函数,对未标签数据进行分类或者回归。

生成式模型的分析

如果将生成式模型假设换为混合专家模型,朴素贝叶斯模型等其他模型那么可以得出其他生成模型半监督学习方法

生成式模型半监督学习方法对于未标签数据的利用 在于参数估计的过程之中,通过大量无标签数据的估计,提升参数估计的效果。

缺点:模型假设准确时,效果会很好,模型假设错误时效果比较差。关键在于正确的假设生成式模型,在现实任务中往往比较困难

优点:有标签数据较少时,并且模型假设正确,往往能获得相对于其他方法更好的效果